Télécharger des fichiers depuis le Web à l'aide de Python

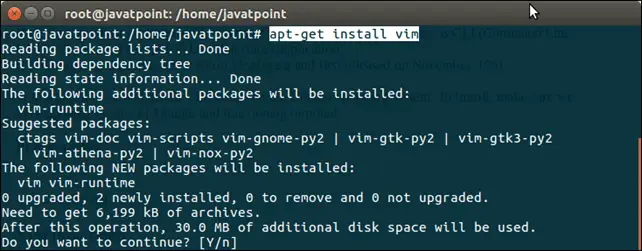

Demandes est une bibliothèque HTTP polyvalente en python avec diverses applications. L'une de ses applications consiste à télécharger un fichier depuis le Web en utilisant l'URL du fichier. Installation: First of all you would need to download the requests library. You can directly install it using pip by typing following command: Puisque toutes les données du fichier ne peuvent pas être stockées par une seule chaîne, nous utilisons r.iter_content méthode pour charger les données en morceaux spécifiant la taille du morceau.

pip install requestsOr download it directly from ici et installez manuellement.

Téléchargement de fichiers

Python3 # imported the requests library import requests image_url = 'https://www.python.org/static/community_logos/python-logo-master-v3-TM.webp' # URL of the image to be downloaded is defined as image_url r = requests . get ( image_url ) # create HTTP response object # send a HTTP request to the server and save # the HTTP response in a response object called r with open ( 'python_logo.webp' 'wb' ) as f : # Saving received content as a png file in # binary format # write the contents of the response (r.content) # to a new file in binary mode. f . write ( r . content )

This small piece of code written above will download the following image from the web. Now check your local directory(the folder where this script resides) and you will find this image: All we need is the URL of the image source. (You can get the URL of image source by right-clicking on the image and selecting the View Image option.) Télécharger des fichiers volumineux

Le contenu de la réponse HTTP ( r.contenu ) n'est rien d'autre qu'une chaîne qui stocke les données du fichier. Il ne sera donc pas possible de sauvegarder toutes les données dans une seule chaîne en cas de fichiers volumineux. Pour surmonter ce problème, nous apportons quelques modifications à notre programme :r = requests.get(URL stream = True)Setting flux paramètre à Vrai entraînera le téléchargement des en-têtes de réponse uniquement et la connexion restera ouverte. Cela évite de lire le contenu d'un seul coup en mémoire pour des réponses volumineuses. Un morceau fixe sera chargé à chaque fois pendant que r.iter_content is iterated. Here is an example: Python3

import requests file_url = 'http://codex.cs.yale.edu/avi/db-book/db4/slide-dir/ch1-2.pdf' r = requests . get ( file_url stream = True ) with open ( 'python.pdf' 'wb' ) as pdf : for chunk in r . iter_content ( chunk_size = 1024 ): # writing one chunk at a time to pdf file if chunk : pdf . write ( chunk )

Téléchargement de vidéos

Dans cet exemple, nous souhaitons télécharger toutes les conférences vidéo disponibles sur ce site. page web . Toutes les archives de cette conférence sont disponibles ici . So we first scrape the webpage to extract all video links and then download the videos one by one. Python3 import requests from bs4 import BeautifulSoup ''' URL of the archive web-page which provides link to all video lectures. It would have been tiring to download each video manually. In this example we first crawl the webpage to extract all the links and then download videos. ''' # specify the URL of the archive here archive_url = 'https://public.websites.umich.edu/errors/404.html def get_video_links (): # create response object r = requests . get ( archive_url ) # create beautiful-soup object soup = BeautifulSoup ( r . content 'html5lib' ) # find all links on web-page links = soup . findAll ( 'a' ) # filter the link sending with .mp4 video_links = [ archive_url + link [ 'href' ] for link in links if link [ 'href' ] . endswith ( 'mp4' )] return video_links def download_video_series ( video_links ): for link in video_links : '''iterate through all links in video_links and download them one by one''' # obtain filename by splitting url and getting # last string file_name = link . split ( '/' )[ - 1 ] print ( 'Downloading file: %s ' % file_name ) # create response object r = requests . get ( link stream = True ) # download started with open ( file_name 'wb' ) as f : for chunk in r . iter_content ( chunk_size = 1024 * 1024 ): if chunk : f . write ( chunk ) print ( ' %s downloaded! n ' % file_name ) print ( 'All videos downloaded!' ) return if __name__ == '__main__' : # getting all video links video_links = get_video_links () # download all videos download_video_series ( video_links )

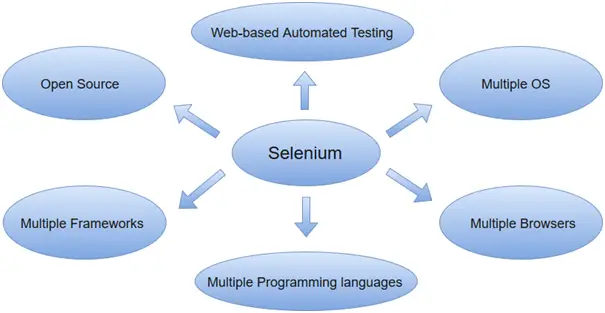

Advantages of using Requests library to download web files are: - On peut facilement télécharger les répertoires Web en itérant de manière récursive sur le site Web !

- Il s’agit d’une méthode indépendante du navigateur et beaucoup plus rapide !

- On peut simplement gratter une page Web pour obtenir toutes les URL de fichiers sur une page Web et donc télécharger tous les fichiers en une seule commande.

Implémentation du Web Scraping en Python avec BeautifulSoup