Algorithmen für maschinelles Lernen

Algorithmen für maschinelles Lernen sind Rechenmodelle, die es Computern ermöglichen, Muster zu verstehen und auf der Grundlage von Daten Vorhersagen zu treffen oder Urteile zu fällen, ohne dass eine explizite Programmierung erforderlich ist. Diese Algorithmen bilden die Grundlage moderner künstlicher Intelligenz und werden in einer Vielzahl von Anwendungen eingesetzt, darunter Bild- und Spracherkennung, Verarbeitung natürlicher Sprache, Empfehlungssysteme, Betrugserkennung, autonome Autos usw.

Das Algorithmen für maschinelles Lernen Der Artikel behandelt alle wesentlichen Algorithmen des maschinellen Lernens Unterstützungsvektormaschine, Entscheidungsfindung, Logistikregression, Naive-Bayees-Klassifikator, Random Forest, K-Mean-Clustering, Reinforcement Learning, Vektor, hierarchisches Clustering, xgboost, adaboost, Logistik usw.

Arten von Algorithmen für maschinelles Lernen

Es gibt drei Arten von Algorithmen für maschinelles Lernen.

- Überwachtes Lernen

- Rückschritt

- Einstufung

- Unbeaufsichtigtes Lernen

- Clustering

- Dimensionsreduktion

- Verstärkungslernen

1. Überwachter Lernalgorithmus

Überwachtes Lernen ist eine Art maschineller Lernalgorithmus, bei dem wir beschriftete Datensätze zum Trainieren des Modells oder der Algorithmen verwenden. Das Ziel des Algorithmus besteht darin, eine Zuordnung der Eingabedaten zu den Ausgabebezeichnungen zu erlernen, die es ihm ermöglicht, Vorhersagen oder Klassifizierungen für neue, unsichtbare Daten zu treffen.

| Überwachte Algorithmen für maschinelles Lernen |

|---|

Einige der überwachten maschinellen Lernalgorithmen können mit ein wenig Modifikation sowohl für die Klassifizierung als auch für die Regression verwendet werden

Metriken für Klassifizierungs- und Regressionsalgorithmen:

Kreuzvalidierungstechnik:

Optimierungstechnik:

|

2. Unüberwachter Lernalgorithmus

Unbeaufsichtigtes Lernen ist eine Art maschineller Lernalgorithmus, bei dem die Algorithmen verwendet werden, um die Muster, Strukturen oder Beziehungen innerhalb eines Datensatzes mithilfe eines unbeschrifteten Datensatzes zu finden. Es untersucht die inhärente Struktur der Daten ohne vordefinierte Kategorien oder Beschriftungen.

| Unbeaufsichtigte Algorithmen für maschinelles Lernen |

|---|

|

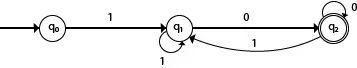

3. Verstärkungslernen

Verstärkungslernen ist eine Art maschineller Lernalgorithmus, bei dem ein Agent lernt, aufeinanderfolgende Entscheidungen zu treffen, indem er mit seiner Umgebung interagiert. Der Agent erhält das Feedback in Form von Anreizen oder Strafen basierend auf seinen Handlungen. Der Zweck des Agenten besteht darin, durch Versuch und Irrtum optimale Taktiken zu entdecken, die den kumulativen Nutzen im Laufe der Zeit maximieren. Reinforcement Learning wird häufig in Szenarien eingesetzt, in denen der Agent lernen muss, wie man sich in einer Umgebung zurechtfindet, Spiele spielt, Roboter verwaltet oder in unsicheren Situationen Urteile trifft.

| Verstärkungslernen |

|---|

|

Liste beliebter Algorithmen für maschinelles Lernen

Hier ist eine Liste der 10 beliebtesten Algorithmen für maschinelles Lernen.

1. Lineare Regression

Die lineare Regression ist ein einfacher Algorithmus, der verwendet wird, um die lineare Beziehung zwischen Eingabemerkmalen und einer kontinuierlichen Zielvariablen abzubilden. Dabei wird eine Linie an die Daten angepasst und dann mithilfe der Linie neue Werte vorhergesagt.

2. Logistische Regression

Die logistische Regression ist eine Erweiterung der linearen Regression, die für Klassifizierungsaufgaben verwendet wird, um die Wahrscheinlichkeit abzuschätzen, dass eine Instanz zu einer bestimmten Klasse gehört.

3. SVM (Support Vector Machine)

SVMs sind überwachte Lernalgorithmen, die Klassifizierungs- und Regressionsaufgaben ausführen können. Es findet eine Hyperebene, die Klassen im Merkmalsraum am besten trennt.

4. KNN (K-nächster Nachbar)

KNN ist eine nichtparametrische Technik, die sowohl zur Klassifizierung als auch zur Regression verwendet werden kann. Es funktioniert, indem es die k Datenpunkte identifiziert, die einem neuen Datenpunkt am ähnlichsten sind, und dann die Bezeichnung des neuen Datenpunkts anhand der Bezeichnungen dieser Datenpunkte vorhersagt.

5. Entscheidungsbaum

Entscheidungsbäume sind eine Art überwachter Lerntechnik, die sowohl zur Klassifizierung als auch zur Regression verwendet werden kann. Dabei werden die Daten in immer kleinere Gruppen segmentiert, bis jede Gruppe mit einem hohen Maß an Genauigkeit klassifiziert oder vorhergesagt werden kann.

6. Zufälliger Wald

Random Forests sind eine Art Ensemble-Lernmethode, die eine Reihe von Entscheidungsbäumen verwendet, um Vorhersagen zu treffen, indem sie Vorhersagen einzelner Bäume aggregieren. Es verbessert die Präzision und Belastbarkeit einzelner Entscheidungsbäume. Es kann sowohl für Klassifizierungs- als auch für Regressionsaufgaben verwendet werden.

7. Naive Bayes

Naive Bayes ist ein probabilistischer Klassifikator, der auf dem Satz von Bayes basiert und für Klassifizierungsaufgaben verwendet wird. Dabei wird davon ausgegangen, dass die Merkmale eines Datenpunkts unabhängig voneinander sind.

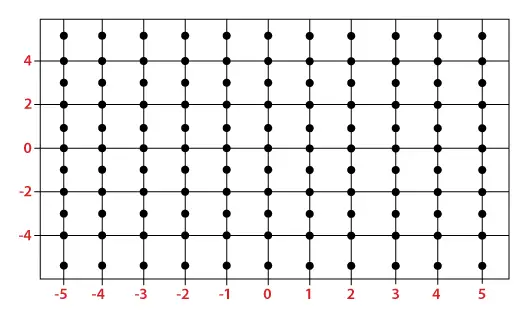

8. PCA (Hauptkomponentenanalyse)

PCA ist eine Technik zur Dimensionsreduktion, die verwendet wird, um Daten in einen niedrigerdimensionalen Raum umzuwandeln und dabei so viel Varianz wie möglich beizubehalten. Dabei werden die Richtungen in den Daten ermittelt, die die größte Variation aufweisen, und die Daten dann auf diese Richtungen projiziert.

9. Apriori-Algorithmen

Der Apriori-Algorithmus ist eine traditionelle Data-Mining-Technik zum Mining von Assoziationsregeln in Transaktionsdatenbanken oder Datensätzen. Es soll Zusammenhänge und Muster zwischen Dingen aufdecken, die bei Transaktionen regelmäßig gleichzeitig auftreten. Apriori erkennt häufige Artikelgruppen, bei denen es sich um Gruppen von Artikeln handelt, die zusammen in Transaktionen mit einem bestimmten Mindestunterstützungsniveau erscheinen.

10. K-Means-Clustering

K-Means-Clustering ist ein unbeaufsichtigter Lernansatz, der zum Gruppieren von Datenpunkten verwendet werden kann. Dabei werden k Cluster in den Daten gefunden, sodass die Datenpunkte in jedem Cluster einander so ähnlich wie möglich sind und sich gleichzeitig so weit wie möglich von den Datenpunkten in anderen Clustern unterscheiden.

Entdecken Sie die grundlegenden Konzepte, die maschinelles Lernen vorantreiben, indem Sie das lernen Top 10 Algorithmen , wie lineare Regression, Entscheidungsbäume und neuronale Netze.

Algorithmus für maschinelles Lernen – FAQs

1. Was ist ein Algorithmus beim maschinellen Lernen?

Algorithmen für maschinelles Lernen sind Techniken, die auf statistischen Konzepten basieren und es Computern ermöglichen, aus Daten zu lernen, Muster zu entdecken, Vorhersagen zu treffen oder Aufgaben zu erledigen, ohne dass eine explizite Programmierung erforderlich ist. Diese Algorithmen werden grob in drei Typen eingeteilt: überwachtes Lernen, unüberwachtes Lernen und verstärkendes Lernen.

2. Welche Arten von maschinellem Lernen gibt es?

Es gibt hauptsächlich drei Arten des maschinellen Lernens:

- Überwachter Algorithmus

- Unbeaufsichtigter Algorithmus

- Verstärkungsalgorithmus

3. Welcher ML-Algorithmus eignet sich am besten für die Vorhersage?

Die ideale Methode des maschinellen Lernens zur Vorhersage wird durch a bestimmt Anzahl der Kriterien , einschließlich der Art des Problems, der Art der Daten und der besonderen Anforderungen. Support-Vektor-Maschinen, Random Forests und Gradient Boosting-Ansätze sind für Vorhersage-Workloads beliebt. Die Auswahl eines Algorithmus hingegen sollte auf der Prüfung und Bewertung des spezifischen Problems und des vorliegenden Datensatzes basieren.

4. Was sind die zehn beliebten Lernalgorithmen?

Nachfolgend finden Sie eine Liste der zehn am häufigsten verwendeten Algorithmen für maschinelles Lernen (ML):

- Lineare Regression

- Logistische Regression

- SVM (Support Vector Machine)

- KNN (K-nächster Nachbar)

- Entscheidungsbaum

- Zufälliger Wald

- Naiver Bayes

- PCA (Hauptkomponentenanalyse)

- Apriori-Algorithmen

- K-Means-Clustering